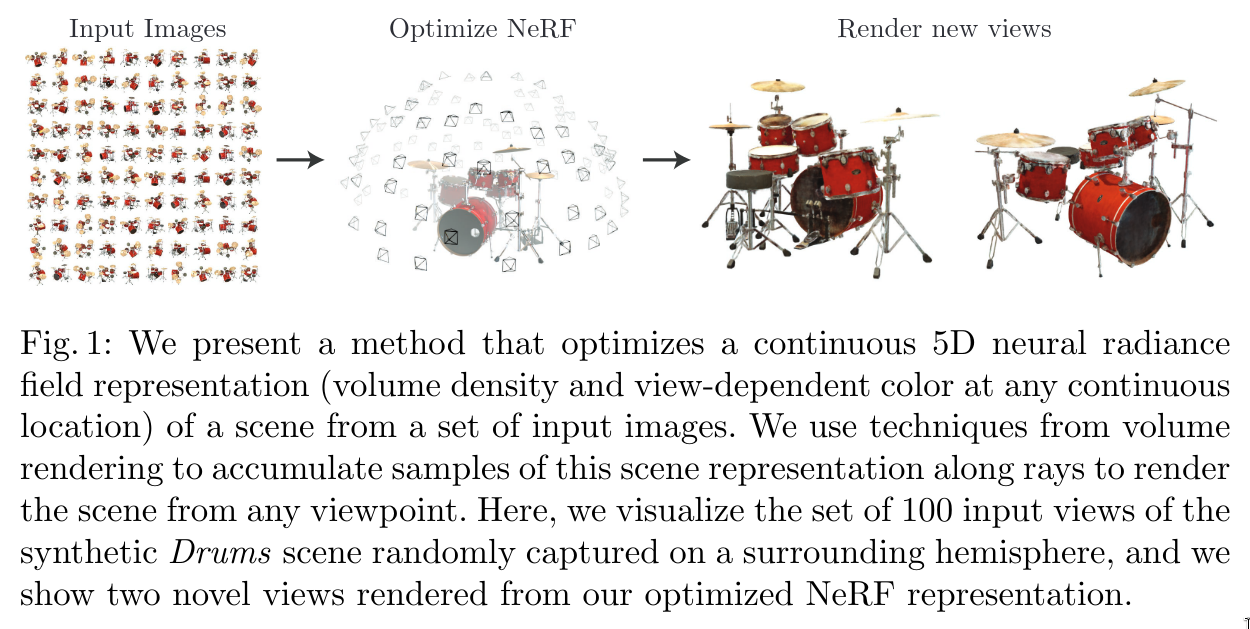

NeRF 论文精读/代码详解 Abstract 本文提出一种方法,通过使用稀疏的输入视图集来优化底层连续体场景函数,从而在合成复杂场景的新视图方面取得了先进的成果。算法使用全连接 (非卷积) 深度网络来表示场景,输入 的是单个连续的5D坐标 (即空间位置 (x,y,z) 和视角 (θ,ϕ)),输出 是该空间的 volume density (体积密度) 和视角相关的 radiance (辐射亮度)。我们通过查询沿相机光线的5D坐标来合成视图,并使用经典的体渲染技术将输出的颜色和密度投影到图像上。由于 volume rendering 本身是可微分的,因此输入只需要已知相机姿态的图像。本文描述了如何有效的优化神经辐射场以渲染具有复杂几何形状和外观场景的逼真新视图,并展示了优于先前神经渲染和视图合成工作的结果。

结果不必多说,是当时最为先进的。

Introduction

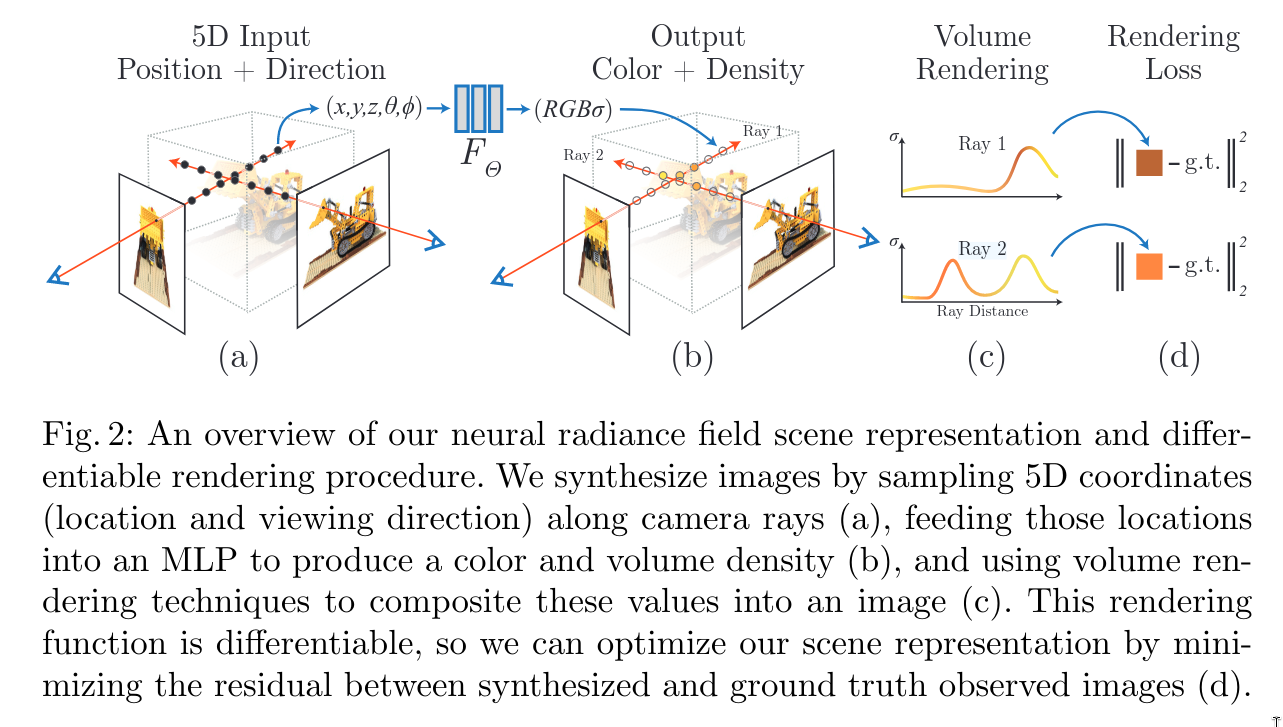

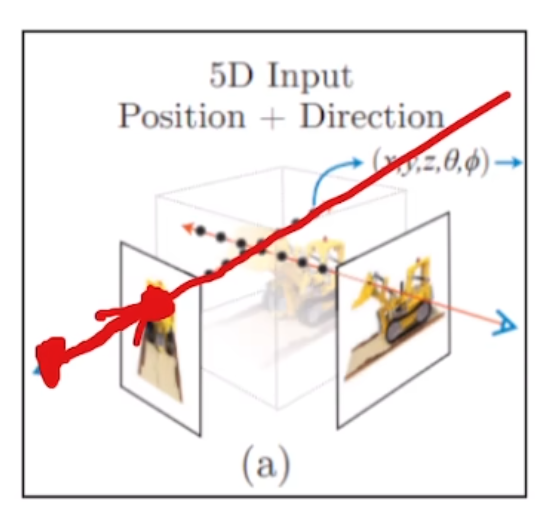

我们将静态场景表示为一个连续的5D函数,该函数输出空间中每个点 (x,y,z) 沿各个方向 (θ,ϕ) 发射的辐射,以及每个点的 density (该密度类似于微分不透明度),控制光线穿过该点 (x,y,z) 时累积的辐射亮度。文章通过 MLP 来表示这个映射,该网络不包含任何卷积层,通过单个五维坐标 (x,y,z,θ,ϕ) 回归到单个体密度和与视角相关的 RGB 颜色来表示该函数。

为了渲染从特定角度的神经辐射场,我们:

将相机光线穿过场景以生成一组采样的3D点;

使用这些点及其对应的2D观察方向作为神经网络的输入,以生成一组颜色和密度的输出;

使用经典的体渲染技术将这些颜色和密度累计成2D图像。

由于该过程本身是可微的,我们可以使用梯度下降法来优化该模型,方式是最小化每个观测图像与我们模型渲染出的对应视图之间的误差。最小化多个视图之间的误差可以促使神经网络预测出场景的连贯模型,具体做法是为包含真实场景内容的区域赋予高密度值和准确的颜色。具体pipline如下图:

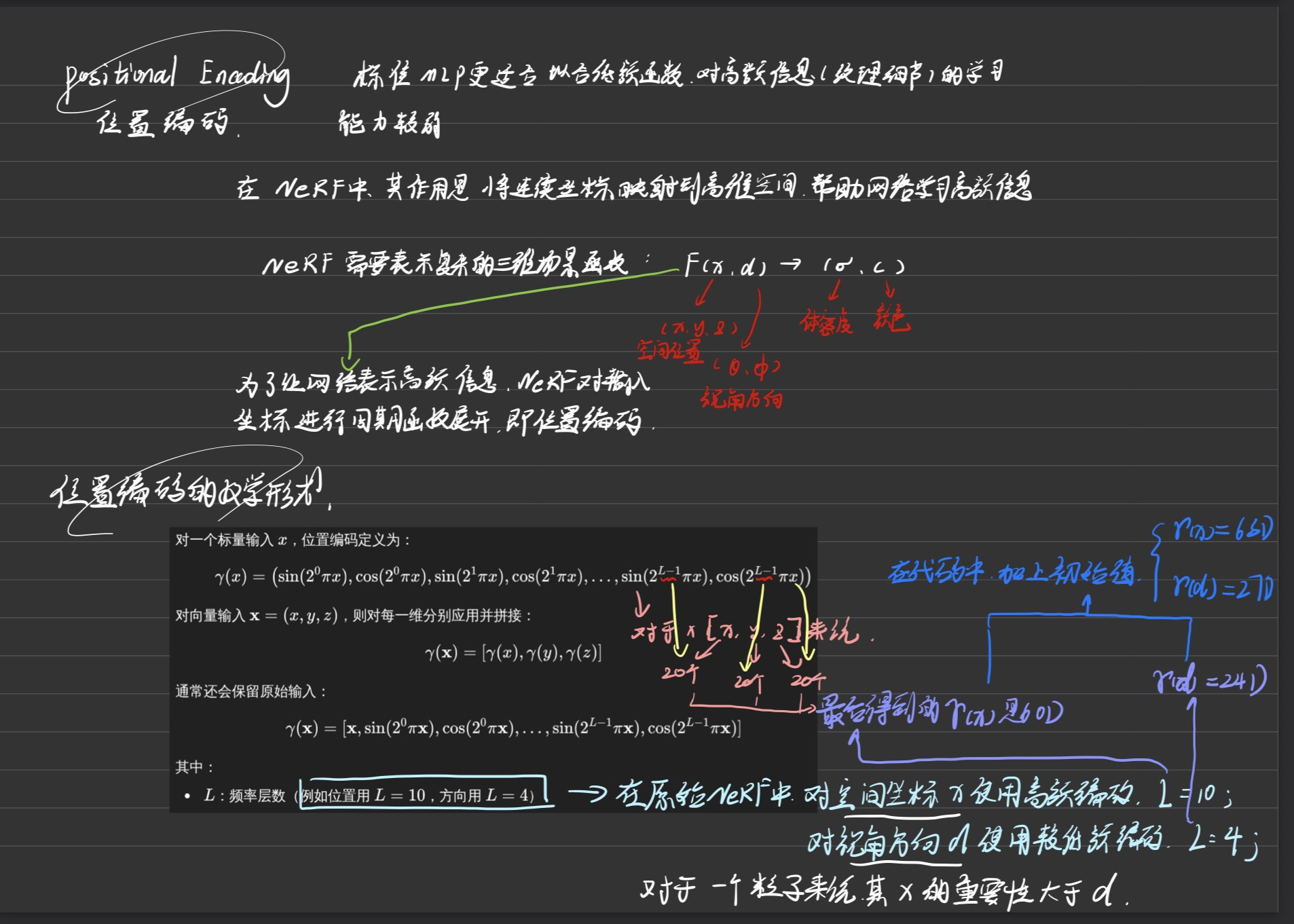

我们发现,针对复杂场景优化神经辐射场表示的基本实现方法无法收敛到足够高分辨率的表示,并且每个相机光线所需的采样数量也过高。为了解决这些问题,我们采用位置编码转换输入的5D坐标,使 MLP 能够表示更高频率的函数,此外,我们还提出了一种分层采样方法,以减少充分采样这种高频场景表示所需的查询次数。

本文提出的方法继承了体积表示的优势: 两者都能够表示复杂的真实世界几何形状和外观,并且都非常适合使用投影图像进行基于梯度的优化,至关重要的是,我们的方法克服了在高分辨率下对复杂场景进行建模时离散体积网络带来的高昂存储成本。总的来说,本文的主要贡献有:

把一种复杂的场景表示为5D神经辐射场的方法,并参数化为 MLP 网络;

基于可微渲染过程,我们优化这种场景表示。包括分层采样策略,用于将 MLP 的容量分配给具有可见场景内容的空间;

将每个输入的5D坐标映射到更高维度1的空间进行位置编码,是我们能够成功地优化神经辐射场,以表示高频场景内容。

CV 领域一个很有前景的新兴方向是将物体和场景编码到 MLP 的权重中,该 MLP 能够直接从 3D 空间位置映射到形状的隐式表示。然而,这些方法目前还无法像使用离散表示 (例如三角网格或体积网格) 的技术那样,以相同的保真度再现具有复杂几何形状的逼真场景。

Neural 3D shape representations 近年的工作探索了连续3D形状隐式表示为水平集的方式,通过优化深度网络将 (x,y,z) 坐标映射到 signed distance functions 或 occupancy fields。然而,这些模型受限于对真实三维几何形状的访问,而这些真实三维几何形状通常来自合成三维形状数据集,例如ShapeNet。后续研究通过构建可微渲染函数放宽了对真实三维形状的要求,使得仅适用二维图像即可优化神经隐式形状表示。Niemeyer 等人将物体表面表示为 3D occupancy fields,并使用数值方法找到每条光线的表面交点,然后使用隐式微分计算精确导数。每个光线交点位置都作为神经 3D texture field 的输入,这个 field 预测该点的漫反射颜色。Sitzmann 等人使用一种更加不直接的神经 3D 表示,在每个连续的 3D 坐标处简单地输出一个特征向量和RGB颜色,并提出一个由 recurrent neural network 组成的可微渲染函数,该网络沿着每条射线行进以确定表面位置。

尽管这些技术理论上可以表示复杂的高分辨率几何体,但迄今为止它们仅限于几何复杂度较低的简单形状,导致渲染结果过于平滑。我们证明,通过优化网络来编码 5D 辐射场 (具有 2D 视角相关外观的 3D 体),可以表示更高分辨率的几何体和外观,从而渲染出复杂场景的逼真新视角。

View synthesis and image-based rendering 在密集的视图采样下,可以通过简单的光场采样插值技术重建逼真的新视图。对于稀疏视图下的新视图合成,计算机视觉和图形学领域通过从观测图像预测传统的几何和外观表示取得了显著进展。一类常用的方法是使用基于网格的场景表示,这些表示具有漫反射或视图相关的外观。Differentiable rasterizers 或 pathtracers 可以使用梯度下降直接优化网格表示以重现一组输入图像。然而,基于图像重投影的梯度网格优化通常比较困难,可能是由于局部最小值或损失函数的条件数较差造成的。此外,该策略需要在优化之前提供一个具有固定拓扑结构的模板网格作为初始化,这通常不适用于无约束的现实世界场景。

另一类方法是使用体积表示来解决一组输入的 RGB 图像中合成高质量逼真视图的任务。体积方法能真实的表示复杂的形状和材质,非常适合基于梯度的优化,并且比基于 Mesh 的方法产生的视觉干扰更少。早期的体积方法使用观测到的图像来直接给体积上色。最近,一些方法使用包含多个场景的大型数据集来训练深度网络,该网络能从一组输入图像中预测采样的体积表示,然后使用 alpha-compositing 或 沿光线学习的合成来渲染新的视图。其他研究针对每个特定场景优化了 CNN 和 采样体积网络的组合,使得 CNN 可以补偿来自低分辨率体积网络的离散化伪影,或者允许预测的体积网格根据输入的时间而变化。虽然这些技术在新视图合成方面取得不错的结果,但它们扩展到更高分辨率图像的能力受到了限制,因为离散采样导致时间和空间复杂度高,而渲染更高分辨率的图像需要对 3D 空间进行更精细的采样。本文提出方法在 MLP 的参数中编码连续的 volume 来规避这个问题,这不仅产生比先前体积方法更高质量的渲染,而且只需要更小的存储成本。

Neural Radiance Field Scene Representation 我们将连续场景表示为一个5D向量值函数,其输入为一个3D坐标点 𝐱=(x,y,z) 和 2D视角方向 (θ,ϕ) ,输出为发射颜色 𝐜=(r,g,b) 和体密度 σ 。实际上,我们将方向表示为3D笛卡尔单位向量 d 。我们使用MLP网络

pic -> 5D 向量(粒子的空间位姿)的前处理

4D 向量(粒子的颜色以及密度) -> pic 的后处理

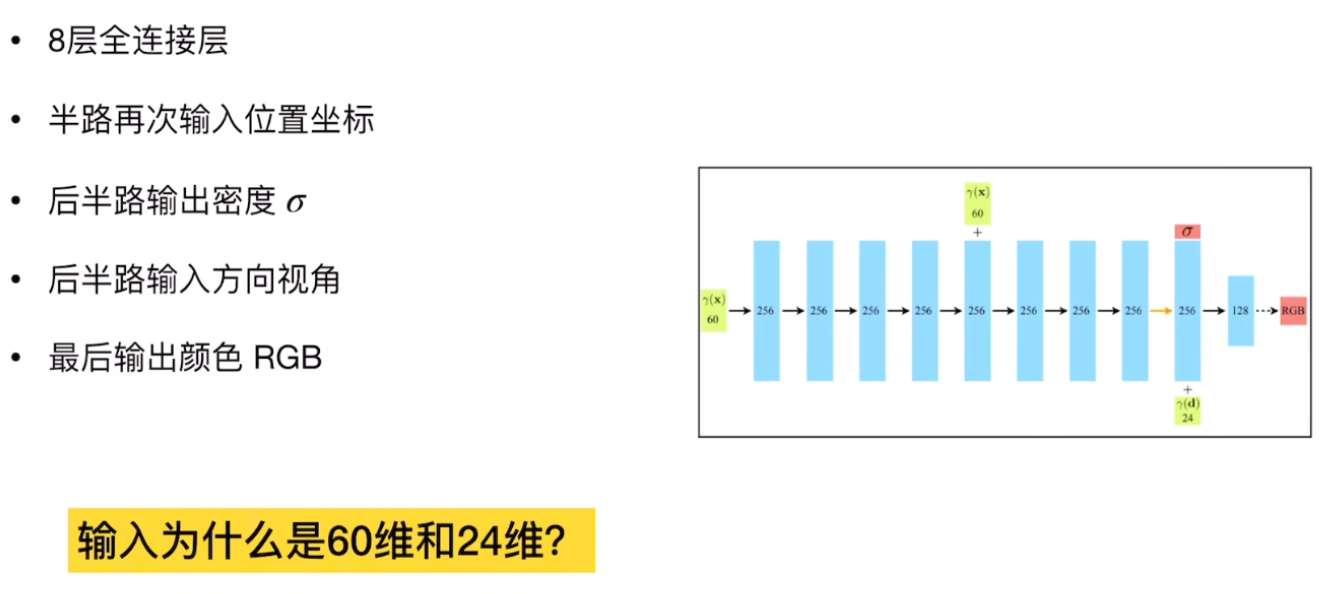

我们通过让网络把体积密度 σ 预测为仅与位置 x 有关,来保证这种表征方法在不同视图下是一致的,同时将RGB颜色 c 预测为位置和观察方向的函数。为了达到这个目标,MLP 首先使用8层全连接层 (使用 ReLU 激活函数,每层 256 个通道) 处理输入的3D坐标 x ,并输出 σ 和一个 256 维特征向量。然后,将该特征向量与相机光线的视角方向连接起来,并传递给另一个全连接层(使用 ReLU 激活函数,每层 128 个通道),该层输出与视角相关的RGB颜色。

代码详解 1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 19 20 21 22 23 24 25 26 27 28 29 30 31 32 33 34 35 36 37 38 39 40 41 42 43 44 45 46 47 48 49 50 51 52 53 54 55 56 57 58 59 60 61 62 63 64 65 66 67 68 69 70 71 72 73 74 75 76 77 78 79 80 81 82 83 84 85 86 class NeRF (nn.Module): // 网络结构: 输入 → 编码位置 (128 维) → 8 个全连接层(256 通道) → 跳跃连接(第4 层) → 编码方向(48 维) → 额外FC层 → 输出(RGB + 密度)def __init__ (self, D=8 , W=256 , input_ch=3 , input_ch_views=3 , output_ch=4 , skips=[4 ], use_viewdirs=False ): """ """ super (NeRF, self ).__init__()self .D = D // D = 8 , W= 256 表示8 个全连接层(256 通道)self .W = Wself .input_ch = input_ch // 编码后的位置维度self .input_ch_views = input_ch_views // 编码后的方向维度self .skips = skipsself .use_viewdirs = use_viewdirsself .pts_linears = nn.ModuleList(if i not in self .skips else nn.Linear(W + input_ch, W) for i in range (D-1 )])self .views_linears = nn.ModuleList([nn.Linear(input_ch_views + W, W//2 )])if use_viewdirs:self .feature_linear = nn.Linear(W, W) // 处理位置MLP输出self .alpha_linear = nn.Linear(W, 1 ) // 输出体积密度self .rgb_linear = nn.Linear(W//2 , 3 ) // 输出颜色else :self .output_linear = nn.Linear(W, output_ch) // 直接用一层线性输出 output_ch(RGB+alpha)def forward (self, x ):self .input_ch, self .input_ch_views], dim=-1 )for i, l in enumerate (self .pts_linears):self .pts_linears[i](h)if i in self .skips: // 如果当前层是跳跃层,则将原始输入拼接到隐藏层(跳跃连接)。1 )if self .use_viewdirs:self .alpha_linear(h)self .feature_linear(h)1 )for i, l in enumerate (self .views_linears):self .views_linears[i](h)self .rgb_linear(h)1 )else :self .output_linear(h)return outputs def load_weights_from_keras (self, weights ):assert self .use_viewdirs, "Not implemented if use_viewdirs=False" for i in range (self .D):2 * iself .pts_linears[i].weight.data = torch.from_numpy(np.transpose(weights[idx_pts_linears])) self .pts_linears[i].bias.data = torch.from_numpy(np.transpose(weights[idx_pts_linears+1 ]))2 * self .Dself .feature_linear.weight.data = torch.from_numpy(np.transpose(weights[idx_feature_linear]))self .feature_linear.bias.data = torch.from_numpy(np.transpose(weights[idx_feature_linear+1 ]))2 * self .D + 2 self .views_linears[0 ].weight.data = torch.from_numpy(np.transpose(weights[idx_views_linears]))self .views_linears[0 ].bias.data = torch.from_numpy(np.transpose(weights[idx_views_linears+1 ]))2 * self .D + 4 self .rgb_linear.weight.data = torch.from_numpy(np.transpose(weights[idx_rbg_linear]))self .rgb_linear.bias.data = torch.from_numpy(np.transpose(weights[idx_rbg_linear+1 ]))2 * self .D + 6 self .alpha_linear.weight.data = torch.from_numpy(np.transpose(weights[idx_alpha_linear]))self .alpha_linear.bias.data = torch.from_numpy(np.transpose(weights[idx_alpha_linear+1 ]))

Volume Rendering with Radiance Fields 我们的5D神经辐射场将场景表示为空间中任意点的体积密度合方向性辐射。我们使用经典的体渲染原理来渲染穿过场景的任意光线的颜色。体积密度 σ(𝐱) 可以解释为光线终止于位置 x 处无穷小粒子的微分概率。相机光线 𝐫(t)=𝐨+t𝐝 在近边界

函数 T(t) 表示从

体渲染是渲染技术的一个分支,目的是解决云/烟/果冻等非刚性物体的渲染建模,将物质抽象成一团飘忽不定的粒子群,光线在穿过时,是光子跟粒子发生碰撞的过程。

粒子的采集

某一个像素 (u, v) 的颜色是沿着某一条射线上的无数个发光点的颜色“和“,可以利用相机模型去反推这条射线,这个射线的表示方法就是 𝐫(t)=𝐨+t𝐝 。O 为射线原点,d 是方向,t 是距离,理论上 t 从 0 -> 无穷。

代码详解 1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 19 20 21 22 23 24 25 26 27 28 29 30 31 32 33 34 35 36 37 38 39 40 41 42 43 44 45 46 47 48 49 50 51 52 53 54 55 56 57 58 59 60 61 def get_rays (H, W, K, c2w ): 0 , W-1 , W), torch.linspace(0 , H-1 , H)) 0 ][2 ])/K[0 ][0 ], -(j-K[1 ][2 ])/K[1 ][1 ], -torch.ones_like(i)], -1 )sum (dirs[..., np.newaxis, :] * c2w[:3 ,:3 ], -1 ) 3 ,-1 ].expand(rays_d.shape)return rays_o, rays_ddef train ():1 ,2 ]) 0 ], size=[N_rand], replace=False ) 0 ], select_coords[:, 1 ]] 0 ], select_coords[:, 1 ]] 0 )0 ], select_coords[:, 1 ]] def render_rays (... ):0 ], bounds[...,1 ] 0. , 1. , steps=N_samples)if not lindisp:1. -t_vals) + far * (t_vals)else :1. /(1. /near * (1. -t_vals) + 1. /far * (t_vals))if perturb > 0. :.5 * (z_vals[...,1 :] + z_vals[...,:-1 ])1 :]], -1 )1 ], mids], -1 )if pytest:0 )list (z_vals.shape))

我们使用数值积分法来估计这个连续积分。确定性积分法通常用于渲染离散化的体积网格,但它会有效的限制我们表示的分辨率,因为 MLP 只能在一组固定的离散位置进行查询。因此,我们采用分层抽样的方法,将 [

尽管我们使用离散的样本来估计积分,但分层抽样使我们能够表示连续的场景,因为它使得 MLP 在优化过程中在连续的位置进行评估。我们使用这些样本,并根据 quadrature rule 估计 C(r),也就是:

其中,δ σ α σ δ

Optimizing a Neural Radiance Field 在前一节中,我们描述了将场景建模为神经辐射场并从中渲染新视图所需的核心组件。然而,我们发现这些组件不足以达到最先进的质量。为了能够表示高分辨率的复杂场景,我们引入了两项改进。第一项改进是对输入坐标进行位置编码,以辅助 MLP 表示高频函数; 第二项改进是采用分层采样方法,以便高效地对这种高频表示进行采样。

Positional encoding 尽管神经网络是一个通用的函数逼近器,我们发现直接对5D输入进行操作会导致渲染结果在表示颜色和几何形状的高频变化方面表现不佳。这与 Rahaman 等人的最新研究结果一致,该研究表明深度网络倾向于学习低频函数。他们还指出,在将输入传递给网络之前,使用高频函数将其映射到更高维的空间,可以更好地拟合包含高频变化的数据。

我们将这些发现应用于神经场景表征,并证明将 γ

这个函数 γ(⋅) 分别应用于 x 中的三个坐标值(这些坐标值已归一化到 [-1, 1] 中) 以及笛卡尔观察方向单位向量 d 的三个分量 (根据定义,这些分量位于 [−1,1] 中)。在我们的实验中,我们将γ(𝐱) 设置为 L=10 ,将 γ(𝐝) 设置为 L=4 。

在Transformer 架构中也使用了类似的映射,它被称为位置编码 。然而,Transformer 使用它的目的不同,它是将序列中标记的离散位置作为输入提供给一个不包含任何顺序概念的架构。相比之下,我们使用这些函数将连续的输入坐标映射到更高维的空间,从而使我们的 MLP 更容易逼近更高频率的函数。

代码详解

1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 19 20 21 22 23 24 25 26 27 28 29 30 31 32 33 34 35 36 37 38 39 40 41 42 43 44 45 class Embedder :def __init__ (self, **kwargs ):self .kwargs = kwargsself .create_embedding_fn()def create_embedding_fn (self ):self .kwargs['input_dims' ] // 输入维度 d, 如 d = 3 表示 [x,y,z]0 if self .kwargs['include_input' ]:lambda x : x)True :freq_bands=[2 ^0 ,2 ^1 ,2 ^2 ,…,2 ^max_freq]; 否则线性采样频率self .kwargs['max_freq_log2' ]self .kwargs['num_freqs' ]if self .kwargs['log_sampling' ]:2. **torch.linspace(0. , max_freq, steps=N_freqs)else :2. **0. , 2. **max_freq, steps=N_freqs)for freq in freq_bands:for p_fn in self .kwargs['periodic_fns' ]:lambda x, p_fn=p_fn, freq=freq : p_fn(x * freq))self .embed_fns = embed_fnsself .out_dim = out_dimdef embed (self, inputs ):return torch.cat([fn(inputs) for fn in self .embed_fns], -1 )'input_dims' : 3 , 'include_input' : True , 'max_freq_log2' : multires - 1 , 'num_freqs' : multires, 'log_sampling' : True , 'periodic_fns' : [torch.sin, torch.cos]

Hierarchical volume sampling 我们采用的渲染策略是沿每条相机光线在 N 查询点处密集评估神经辐射场网络,但这种策略效率低下:对渲染图像没有贡献的自由空间和遮挡区域仍然会被重复采样。我们从体渲染的早期工作中提取灵感,通过分层样本来提高渲染效率,是其与最终渲染的预期效果成正比。

代码详解 1 2 3 4 5 6 7 8 9 // 分层采样1 阶段:粗采样(64 个点)2 阶段:重要性采样(增加64 个点)3 阶段:精细采样(总128 个点)

我们不仅使用单个网络来表示场景,而是同时优化两个网络: 一个“粗略”网络和一个“精细”网络。我们首先使用分层抽样对一组

将这些权重归一化为

代码详解 1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 19 20 21 22 23 24 25 26 27 // 计算相邻采样点之间的距离1 :] - z_vals[...,:-1 ]1e10 ]).expand(dists[...,:1 ].shape)], -1 ) None ,:], dim=-1 )3 ]) 0. if raw_noise_std > 0. :3 ].shape) * raw_noise_stdif pytest:0 )list (raw[...,3 ].shape)) * raw_noise_std3 ] + noise, dists) 0 ], 1 )), 1. -alpha + 1e-10 ], -1 ), -1 )[:, :-1 ]sum (weights[...,None ] * rgb, -2 ) sum (weights * z_vals, -1 )1. /torch.max (1e-10 * torch.ones_like(depth_map), depth_map / torch.sum (weights, -1 ))

Implementation details 我们针对每个场景优化一个独立的神经连续体表示网络。这仅需要场景的RGB图像数据集、相应的相机位姿和内参以及场景边界 (对于合成数据,我们使用真实相机位姿、内参和边界; 对于真实数据,我们使用 COLMAP 运动结构重建包历来估计这些参数)。在每次优化迭代中,我们从数据集中的所有像素中随机抽取一批相机光线,然后按照分层采样方法,从粗略网络中查询

其中,ℛ 表示每个批次中的光线集合, C(𝐫) 、

在我们的实验中,我们使用 4096 条光线的批次大小,每条光线在粗略体积的 $N_c$=64 坐标处采样,并在精细体积的 β 、 β 和 ϵ

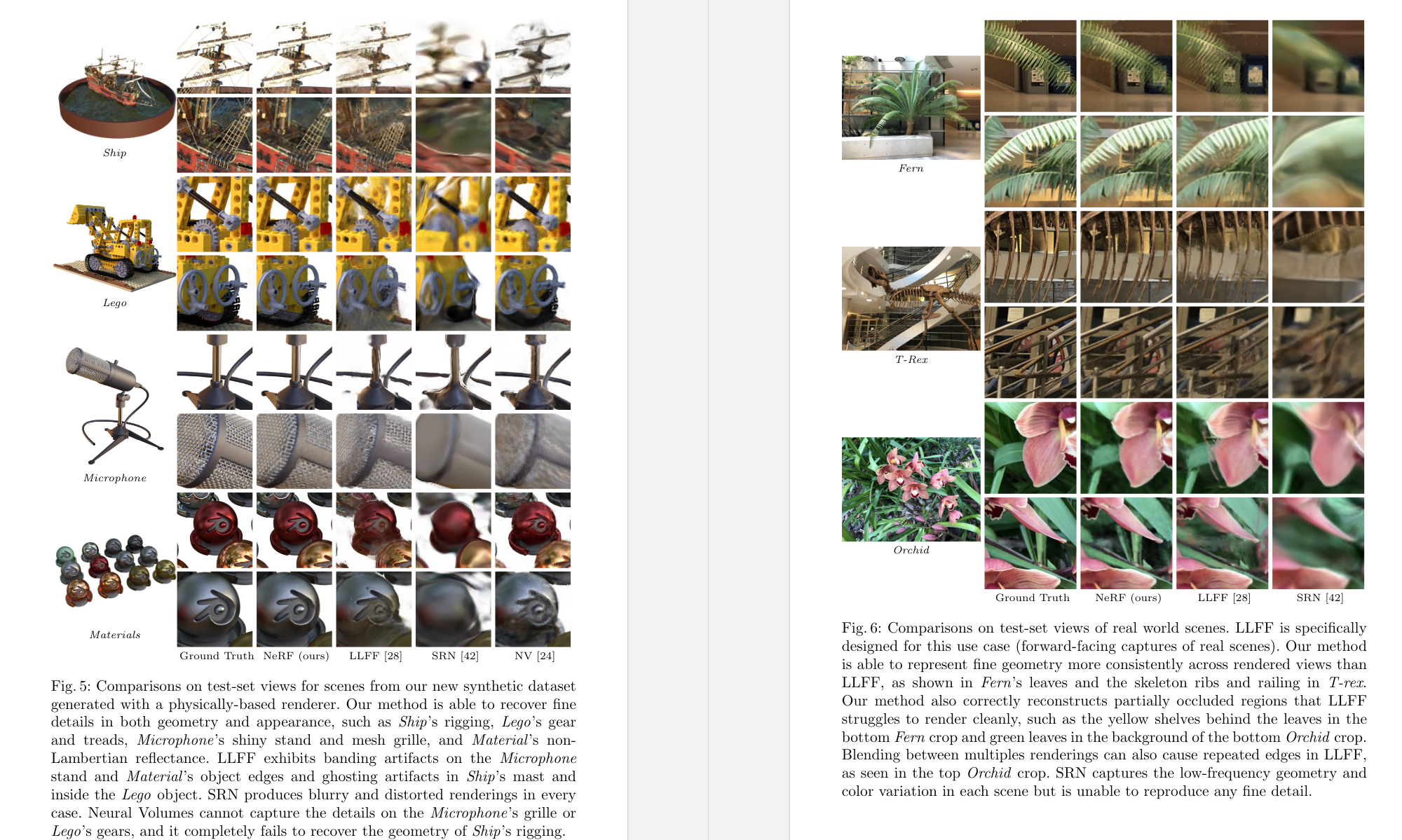

Results

Conclusion 我们的工作直接解决了先前使用 MLP 将物体和场景表示为连续函数的不足之处。我们证明,将场景表示为 5D 神经辐射场 (一种输出体密度和与视角相关的辐射亮度 (作为 3D 位置和 2D 视角方向的函数) 的 MLP) 比之前主流的训练深度卷积网络输出离散体素表示的方法能产生更好的渲染效果。

尽管我们提出了一种分层采样策略来提高渲染的采样效率 (包括训练和测试),但在研究如何高效优化和渲染神经辐射场方面,仍有许多工作要做。未来的另一个研究方向是可解释性: 诸如体素网格和网格状结构之类的采样表示可以推断渲染视图的预期质量和故障模式,但当我们将场景编码到深度神经网络的权重中时,如何分析这些问题尚不明确。我们相信,这项工作朝着基于真实世界图像的图形管线迈出了重要一步,在该管线中,复杂的场景可以由从真实物体和场景图像中优化得到的神经辐射场构成。

Reference

【论文精读】NeRF详解 NeRF: Representing Scenes as Neural Radiance Fields for View Synthesis 【较真系列】讲人话-NeRF全解(原理+代码+公式)